Stable Diffusion

简介

Stable Diffusion 是一款开源的文本到图像生成模型,用户只需输入自然语言提示(prompt),即可生成视觉图像。该模型由 Stability AI 与 CompVis(慕尼黑大学 LMU 的研究团队)等合作开发,首次发布于 2022 年。它采用“潜在扩散模型”(latent diffusion model)技术,先在压缩的潜在空间中添加噪声,再逐步还原图像,从而提高生成速度与效率。

主要功能亮点

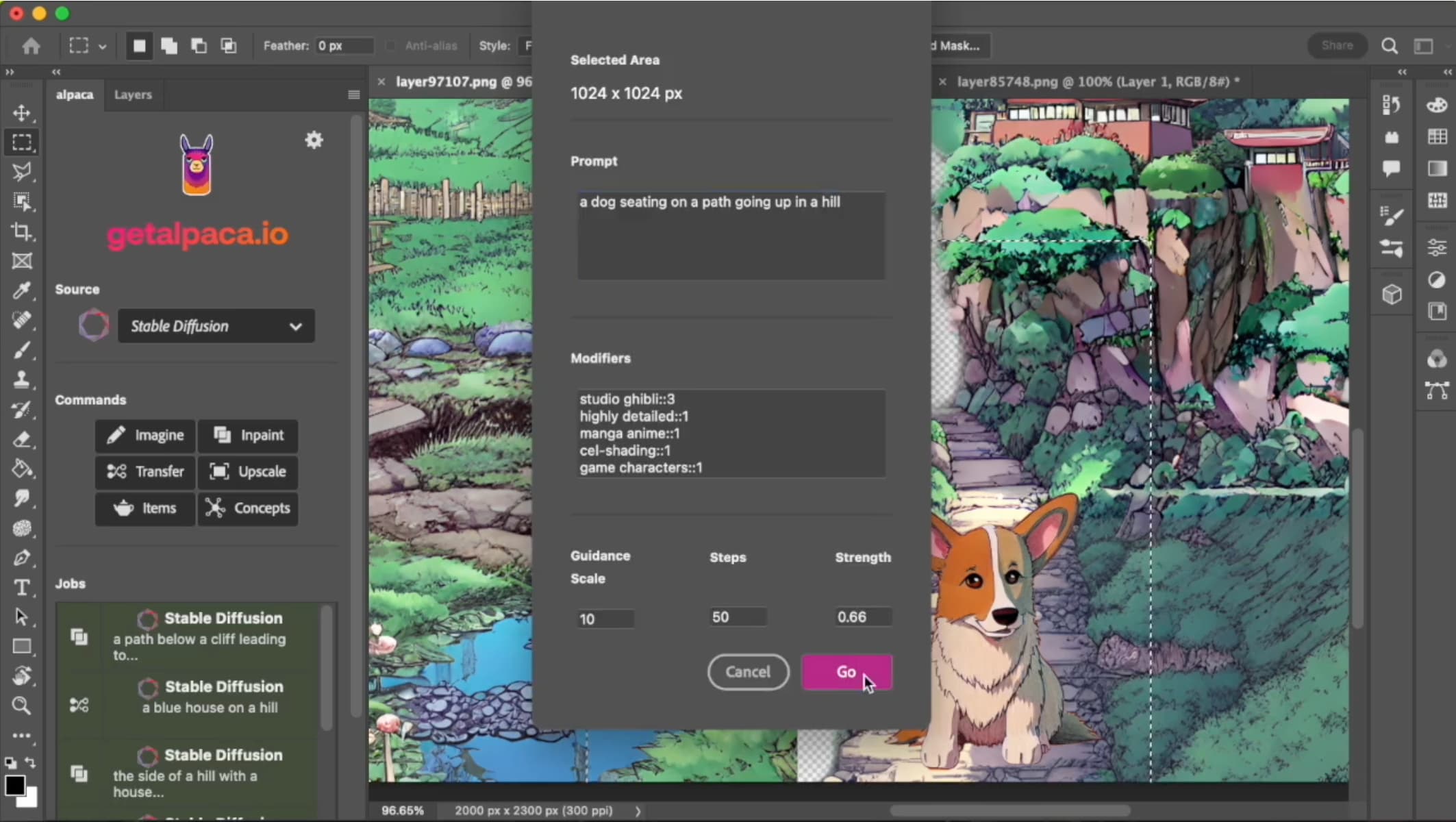

- 从文本到图像:用户输入文字描述,模型会生成响应的视觉图像。

- 支持图像编辑:除了从零生成,还支持“inpainting”(局部修复)与“outpainting”(图像扩展)等操作。

- 开源并可本地运行:代码与权重公开,开发者可在拥有合适 GPU 的设备上运行模型。

- 高自由度与广泛应用:用户可指定风格、参考图像、构图、长宽比等参数,适用于艺术创作、设计概念、视觉探索等。

适用场景

- 视觉创作者/设计师:快速生成概念图、草图、插画或视觉草案。

- 内容制作团队:为社交媒体、广告、短片等需求快速产出图像素材。

- 教育与研究:用于探索生成式 AI、视觉模型、艺术与技术融合等主题。

- 开发者/技术爱好者:自行部署、微调模型、探索生成流程与定制应用。

注意事项

- 虽然功能强大,但生成结果受提示语质量、模型参数、数据集覆盖等因素影响,可能出现与预期不同或不理想的图像。

- 在商业或公开用途时,建议确认使用条款、生成内容的授权状态,以及遵守相关法律法规。

- 虽然模型开源,但仍存在偏见或不当输出风险(例如对某些主题、风格或人物处理不当),使用时应具有责任意识。